如果知识储备多就能产生意识,那互联网早就产生意识了。

甚至整个地球、太阳系、银河系,宇宙都更应该产生意识。

一块石头是石头,10000000000 块石头它还是石头。

虽然你把石头重新架构整合一下,它就能建造出摩天大楼。但关键是,人类只知道这个大楼的效果图是怎么样的,连具体的图纸都没有。

石头再多也不会自己堆起来,变成一栋摩天大楼。

知识的本质是信息在人脑中的表征,而意识其实是人脑处理信息的一种监督和反馈。

ChatGPT 没有架构相关的逻辑基础,自然不可能有意识。

我们来看看意识究竟是什么?

20 世纪 80 年代,心理学家本杰明•李贝特便做了一个著名的实验[1][2]。

他们让 5 个左撇子的大学生坐在躺椅上,并告诉他们用 1~2 秒的时间放松头部、颈部,以及前臂肌肉。但在决定做这一件事情之前,他们需要突然快速动一根手指或手腕。当他们活动手指的时候,不要有任何的预先计划或刻意关注,随机重复 40 次。

在这些大学生进行这些动作时,研究人员测量了三个变量:

1、贴在前臂的电极,记录手指动作开始的时间。

2、贴在头皮上的电极,测试动作开始时大脑的预备电位。

3、感受到行为冲动(想动手指)时,喊出屏幕中钟表的“时间”,从而测出决定时刻。

经过多达几百次实验,李贝特最终都发现,决定时刻出现在大脑预备电位之后。

平均时间间隔为 350ms。

也就是说,当我们决定做某一件事情之前的 1/3 秒,大脑就已经发起动作了。

因此,有研究者悲观地认为人类并没有自由意识。

不过在进一步的实验中,李贝特让被试大学生,在做决定之后否决行为。

虽然大脑出现了预备动作电位,但最终阻止了动作,没有检测到手上的电位。近年来的也有研究进一步表明,当大脑动作电位出现后一定时间内,可以进行否决,但距离动作时间足够近时,否决的成功率便会大大降低[3]。

这说明,无论人类有没有自由意识,但在一定时间内都有否决的自由。

40 年来,有大量的研究支持李贝特实验中意识决定延于与大脑动作的结果。延后时间短则数百毫秒,最长甚至可达 10 余秒[4][5][6]。

一项实验中,经颅磁刺激改变受试者的左右手使用习惯后,受试者依旧认为自己的选择经过了自由意识的决定[7]。在某些实验设计下,当出现无意识判断或冲动行为,受试者也会认为是自己的决策行为[8]。

直接对高级皮层进行刺激,受试者则可能出现错误的意识判断。例如,他们可能认为自己做出了某种动作,但实际并非发生[9]。

这似乎更加肯定了人类没有自由意识。

然而,最近 10 多年一些研究者却有了进一步的发现,有研究者否定了人类没有自由意志的看法。

2009 年,有人把李贝特的经典实验,修改为播放一段音频,然后让志愿者决定是否敲击一个键。研究发现,不管志愿者是否真的选择了敲击,两种情况下都有相同的大脑预备电位。

这表明,大脑预备电位并不表明已经做出了决定。

当然志愿者即刻决定是用左手还是右手按键时,大脑的早期动作电位同样没有什么区别,这说明大脑早期产生的动作电位,可能是注意到信号或者对信息的预处理。

近年来,越来越多更精确的方法,证明意识决定不是瞬间出现的,而是逐步建立起来的。因此有研究者认为,决策结果的早期神经标记不是无意识的,而是简单地反映了有意识的目标评估阶段,这些阶段还不是最终的,在达成最终意识活动之前,这个决策可以终止或改变[10]。

总之,一个动作可能在我们的“意识”意识到它之前就已经开始了,并不意味着我们的意识不能批准、修改或者取消这个动作。

结合现有的各种神经科学证据,我们不难得到这样的推测:

大脑整合信息本身就是先到初级皮层,然后再到更高级的皮层。初级皮层随时随地都在获得信息,以供高级皮层使用。高级皮层在做决定之前,总是先要调控初级皮层的信息。在获得信息之后,有决定去做或者不去做的权利。

而当初级皮层先对我们的躯体进行控制,信息反馈到高级皮层后,也可能被当做成我们的主观决定。

这样,大脑依旧是具有一定程度自由意识的。

当然“自由意识”概念的定义本身也是充满争议的,在对“自由意识”具有更严格定义的人眼中,人依旧是没有自由意识的。

无论意识是否自由,李贝特实验都证明了意识是大脑进行信息整合时产生的一种感知。

单个感觉神经元的活动是十分嘈杂(具有很高的神经元噪声),无法在大脑内重建感觉场景。

为了解释大脑内的神经回路,早在 1949 年,著名神经科学家唐纳德·赫布提出的赫布理论(突触可塑性的基本原理)中,便有了神经元集群的概念。

相关实验也表明,当猴子进行伸手和抓握运动时,神经元集群同时编码手臂位置、速度和手的抓握力,注意和记忆的位置都可以被解码的。[11]

到了 20 世纪末,有神经科学家通过神经元群体解释了运动皮层的编码方向。

在神经元集群的概念下,其实大脑神经通路和稻草编制的长绳很相似,你追溯单根稻草的轨迹是很难得到整根绳子信息的,所有稻草信息的集合才是整根绳子。单根稻草的不确定信息在集合成整根绳子的时候,被平均掉了,最终得到的是整根绳子的信息。

神经元集群的基本单位是皮质柱(Cortical Column)[12]。

通过在皮质表面垂直插入探针连续穿透,发现的几乎相同的感受野(receptive field,一个神经元所反应的刺激区域),因为把整个区域的神经元集群称为皮质柱。

皮质柱内的神经元编码具有相似特征,这支持了大脑皮层的模块化。

虽然皮质柱假说依旧是当前解释皮层信息处理的最广泛假说之一[13],然而遗憾的是,模块化的功能结构和遗传机制,依旧没有相关研究结果所支持[14]。

虽然人类还无法破译意识的框架和底层逻辑,但目前依旧有四大主流的意识理论,尝试进行解释。

人类解释意识框架的主要意识理论

1、高阶理论(HOTs)

- 心理状态→元心理状态(高阶表象)

该理论认为,普通心理状态转变成高阶的元心理,从而诞生了意识。

一般来说,前额叶和人类的高级认知功能密切相关[15]。

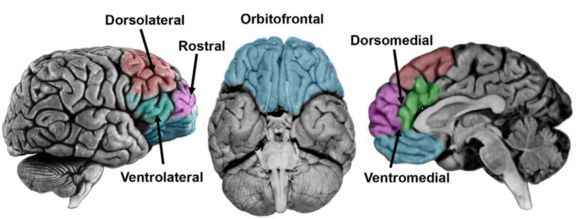

前额叶皮层分为背外侧、腹外侧、内侧和眶额皮层,各个区域有不同的功能,但并不是这里分析的重点[16]。

前额叶最晚进化出现,也是人类发育最晚成熟的脑结构,是人类最高级中枢,执行着抽象认知、注意力调控、行为决策、思维推理、工作记忆等与意识高度相关的活动。

高阶理论其实是建立在前额叶功能的基础上的,但个人认为这还是过于形而上。

作为高阶的元心理是凌驾于普通心理之上的,而前额叶和其它高级皮层终究是并列的,且并不仅仅是前额叶参与意识的形成,其它一些关键脑区同样参与。

但如果我们定义前额叶诞生的意识就是元心理,这个理论便陷入循环论证。

全局工作空间理论(GWT)

这个理论,是把大脑看做是执行不同功能的专用模块,并通过长距离连接,信息在不同模块之间传播和共享,每一时刻的及时全局共享诞生意识。

这个理论很明显是以大脑分区以及联络关系作为理论基础的,它同样有脑科学的基本研究支撑。但这个理论关于全局的概念,依旧是抽象而不明晰的。

如果我们定义能诞生意识的共享就是全局的,这个理论同样会陷入循环论证。

信息整合理论(IIT)

这个理论明显是以大脑的信息整合机制作为基础的,它意图以现象特征为基础,构建一套几何式公理,显示出了庞大的野心 。

该理论的基础逻辑,是探讨大脑整合信息时的因果机制和状态。它提出,任何系统,只要产生一个非零的不可约的整合信息的最大值,便足以诞生仪式。

一直以来,我都认为信息整合理论是解释意识起源的最可能的方向之一。但个人认为,这个整合过程也可能是混沌的,它是否真的存在一个标准范式,是值得争议的。而且,即便真的存在标准范式,意识的诞生方式,也并不一定是该理论提出的形式。

再入和预测处理理论

该理论强调了自上而下信号对形成和塑造有意识感知的重要性。

大脑(高级皮层)再处理(或再发生)感知皮层内的局部信息便足以产生意识。

这个理论,同样脱胎于现有的意识相关研究。

似乎能很好地解释一些意识研究自上而下的机制,以及关于意识的延迟现象。

这个理论的确能够解释局部意识,相当于大脑对感官产生原因的最佳猜测。

除了以上四个理论,还有一个理论的呼声很大,那就是“注意力图式”理论。

该理论的核心主张是,“注意力图式”是大脑计算注意力过程和当前状态的简化模型[17]。

根据该理论,诸如“我意识到XX”包括以下步骤:

刺激XX在大脑中被编码为一种表征,与其他刺激表征竞争大脑有限的处理资源。

如果刺激XX赢得了这种信号竞争,它就会被大脑深度处理,从而加入“注意力图式”。

“注意力图式”是一种内在模型,是选择性地获取 XX 的一些基本特征,例如颜色、形状、位置等,从而诞生的一种简化模型。

其实我们不难发现,当我们意识到一个物体时,当把这个物体拿走,我们也能在脑海中构想出它的基本特征。虽然我们无法确定“注意力图式”理论的正确性,但大脑处理工作记忆的方式,很明显是符合“注意力图式”。

“注意力图式”是最为机械化解释意识的一种理论,但再结合以上四种意识理论,我们或许更加接近意识的真相。

首先,意识是整合的,高级皮层再处理不同分区初级皮层中的信息时,产生的一种简化模型,可能是意识形成的基础。这个整合过程,或许是通过某种范式(例如数学关系)达成的。如果意识过程超出一般心理的范畴,它也而可能是更高阶的。

意识的产生,远远比普通人想象的复杂得多。很多人总是在幻想奇迹,人工智能会不会自己产生意识。

如果在人类不知道意识具体底层逻辑的情况下,完全依赖“死”的底层逻辑,人工智能能产生意识,那恐怕和让猴子敲出《莎士比亚》没啥区别。

在人类没有完全破译之前,人工智能是不可能无条件产生意识的。

当然,除了直接设计出具有意识的人工智能外,其实人类在未来还可以通过另外一个方式,让人工智能产生意识——模仿生物的演化。

设计出完全不需要人类参与生产的简单机器,对这些机器设置有限的生命,拥有生存、繁殖,以及死亡机制,且芯片可随着繁殖产生随即模块,可以通过自然 / 人工选择,不断演化。每次改变环境,生存下来的机器都会更加的适宜环境,如果对环境做到有意识的控制,就能产生需要的更复杂更智能的机器。

随着这些机器自主智能越来越高,未来就有可能像碳基高等生命一样,自己产生意识。

当然,对演化的模拟也是一个无比巨大的工程。

是直接设计有意识的人工智能更难,但是依靠有条件的演化产生意识更难,是未知的。

其实人工智能本身就是模仿的人类大脑的网络学习机制。

我个人认为在一定的架构基础上,通过创造必须条件让人工智能自己演化,会更容易诞生真正的意识。

但至于未来是否还在人类可控范围内……

打开潘多拉魔盒之前,我们对未来一无所知。